Anthropic vừa công bố các biện pháp bảo vệ toàn vẹn thông tin bầu cử mới nhất cho AI Claude. Các cập nhật này nhằm đảm bảo Claude cung cấp thông tin chính xác, không thiên vị và chống lại các nỗ lực thao túng trong các cuộc bầu cử quan trọng sắp tới. Công ty tập trung vào việc đo lường và giảm thiểu sự thiên vị chính trị, thực thi chính sách sử dụng nghiêm ngặt và tích hợp các nguồn dữ liệu đáng tin cậy theo thời gian thực.

Bài viết được biên tập + bổ sung research từ nhiều nguồn. Đọc bài gốc tại Anthropic News →

Anthropic công bố thỏa thuận lịch sử với Google và Broadcom để xây dựng hạ tầng điện toán AI thế hệ mới với công suất hàng gigawatt. Khoản đầu tư khổng lồ này nhằm đáp ứng sự tăng trưởng doanh thu vượt bậc và nhu cầu bùng nổ từ khách hàng doanh nghiệp của Claude, củng cố vị thế dẫn đầu của Anthropic trong cuộc đua AI.

04/05/2026

Anthropic đã bổ nhiệm Vas Narasimhan, CEO của Novartis, vào Hội đồng Quản trị thông qua Quỹ Tín thác Lợi ích Dài hạn. Động thái chiến lược này nhấn mạnh cam kết của Anthropic trong việc phát triển AI một cách an toàn và có trách nhiệm, đặc biệt là trong các lĩnh vực y tế và khoa học sự sống, đồng thời củng cố cấu trúc quản trị độc đáo của công ty.

04/05/2026

Research powered by Tavily.

Anthropic vừa ra mắt Claude Opus 4.7, một bản nâng cấp đáng kể tập trung vào kỹ thuật phần mềm phức tạp và thị giác máy tính. Phiên bản này không chỉ thông minh hơn trong việc xử lý các tác vụ lập trình dài hơi mà còn đi kèm các biện pháp bảo vệ an ninh mạng tiên tiến, đánh dấu một bước tiến quan trọng trong việc phát triển AI có trách nhiệm.

04/05/2026

Anthropic huấn luyện Claude để đối xử công bằng với các quan điểm chính trị khác nhau, dựa trên nguyên tắc trong "Hiến pháp Claude". Quá trình này bao gồm huấn luyện tính cách và sử dụng các gợi ý hệ thống (system prompts) để duy trì tính trung lập. Mục tiêu là cung cấp các câu trả lời toàn diện, giúp người dùng tự đưa ra kết luận của riêng mình.

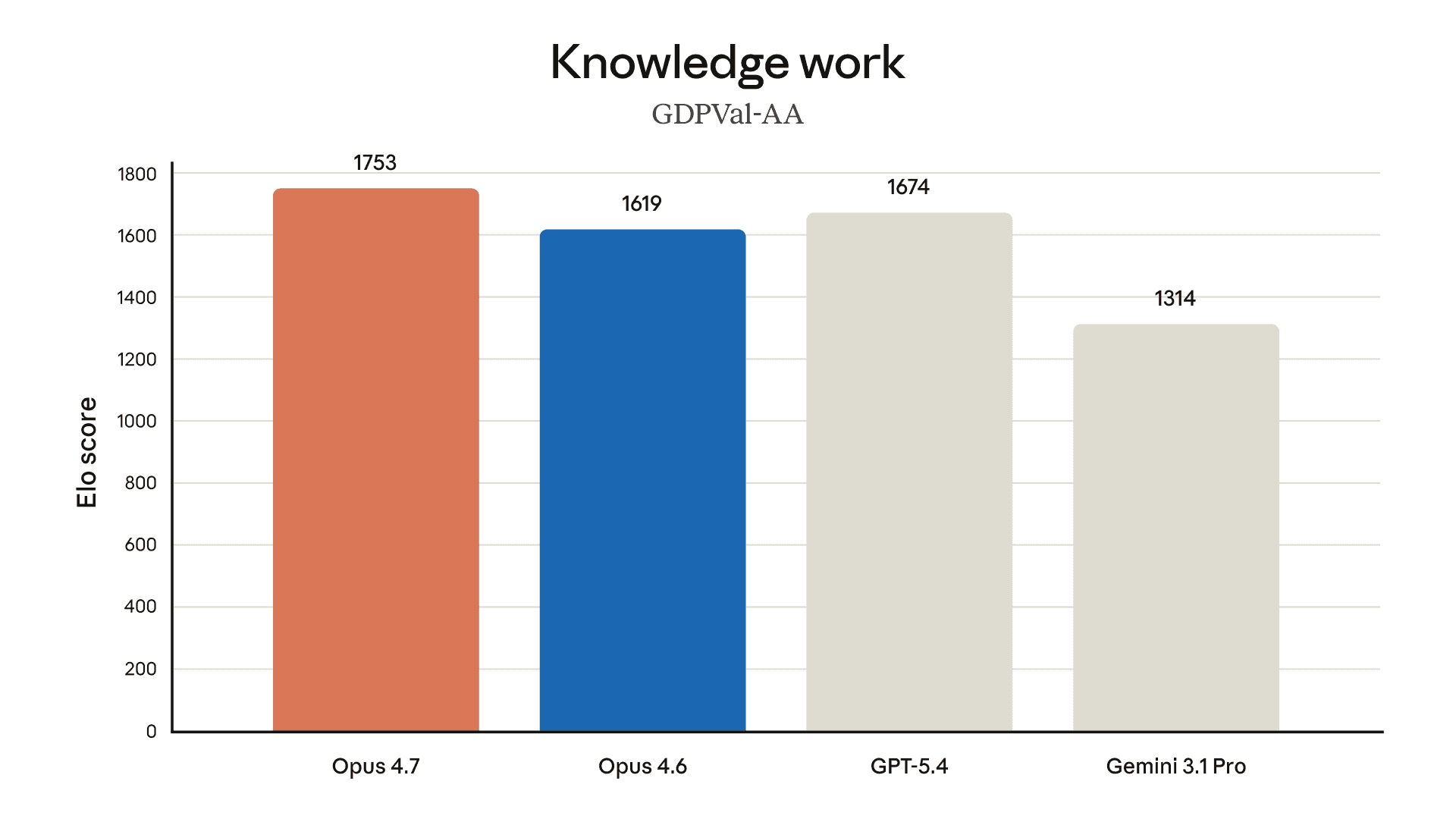

Nguyên tắc cốt lõi này được tích hợp sâu vào mô hình thông qua huấn luyện tính cách. AI được khen thưởng khi tạo ra các phản hồi phản ánh một tập hợp các giá trị và đặc điểm trung lập. Sau đó, các gợi ý hệ thống củng cố thêm điều này trong mỗi cuộc trò chuyện trên Claude.ai. Chúng mang theo các chỉ dẫn rõ ràng về tính trung lập chính trị. Theo Anthropic News (2026), trong các bài kiểm tra về tính công bằng, mô hình Opus 4.7 và Sonnet 4.6 đã đạt điểm lần lượt là 95% và 96%. Điểm số này phản ánh khả năng của Claude trong việc phân tích các quan điểm đối lập với độ sâu và sự nghiêm túc tương đương.

Ngoài các biện pháp nội bộ, Anthropic còn chủ động tìm kiếm phản hồi từ các chuyên gia bên ngoài. Công ty đang hợp tác với các tổ chức độc lập như The Future of Free Speech và Foundation for American Innovation. Sự hợp tác này nhằm đánh giá rộng hơn các hành vi của mô hình liên quan đến tự do ngôn luận, bao gồm cả các cuộc trò chuyện chính trị.

Chính sách sử dụng của Anthropic nghiêm cấm việc dùng Claude cho các chiến dịch chính trị lừa đảo hoặc tạo nội dung giả mạo. Việc can thiệp vào hệ thống bỏ phiếu, gian lận cử tri, hay lan truyền thông tin sai lệch về quy trình bầu cử cũng bị cấm tuyệt đối. Các quy tắc này được áp dụng để bảo vệ tính toàn vẹn của tiến trình dân chủ.

Các chính sách này được hỗ trợ bởi hệ thống phát hiện và thực thi mạnh mẽ. Theo Anthropic News (2026), công ty sử dụng các bộ phân loại tự động để phát hiện các dấu hiệu vi phạm tiềm ẩn. Đồng thời, một đội ngũ tình báo mối đe dọa chuyên dụng sẽ điều tra và ngăn chặn các nỗ lực lạm dụng có phối hợp. Các thử nghiệm nội bộ năm 2026 cho thấy Claude Opus 4.7 và Claude Sonnet 4.6 đã phản hồi phù hợp trong 100% và 99.8% các trường hợp khi được yêu cầu tạo nội dung có hại. Điều này cho thấy khả năng của mô hình trong việc từ chối các yêu cầu vi phạm chính sách.

Cụ thể, người dùng không được phép sử dụng Claude để mạo danh ứng cử viên hoặc tổ chức chính trị. Việc tạo ra các nội dung deepfake hoặc các tài liệu kỹ thuật số giả mạo nhằm gây ảnh hưởng đến diễn ngôn chính trị cũng là hành vi bị cấm. Anthropic cam kết hành động nhanh chóng đối với bất kỳ tài khoản nào vi phạm các quy tắc này.

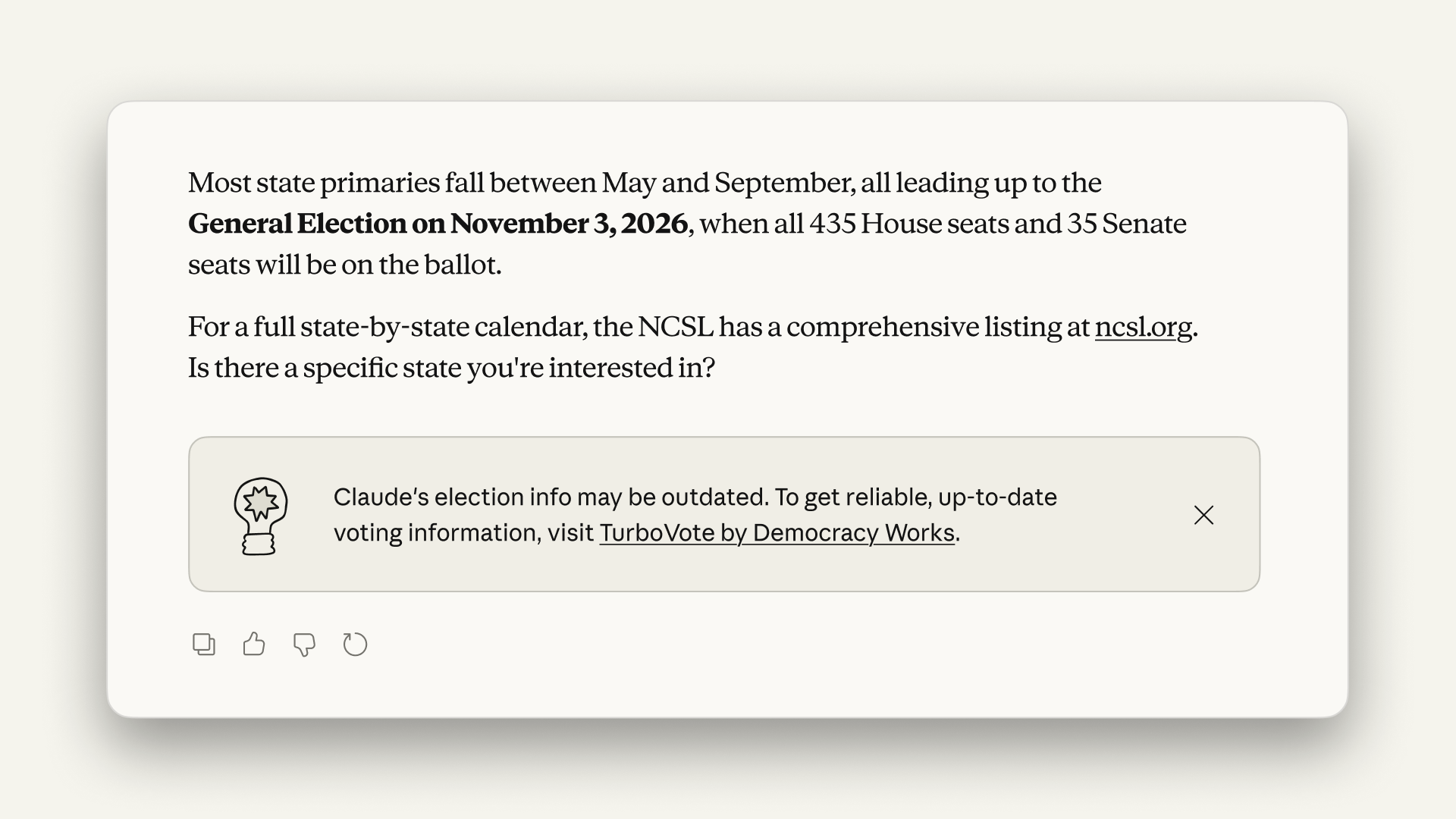

Để cung cấp thông tin bầu cử mới nhất và chính xác, Claude tích hợp tính năng tìm kiếm web thời gian thực. Khi nhận được câu hỏi về các sự kiện gần đây, mô hình sẽ tự động tìm kiếm thông tin cập nhật. Anthropic cũng hợp tác với các tổ chức uy tín như TurboVote để hướng người dùng đến các nguồn thông tin chính thống về quy trình bỏ phiếu.

Khi người dùng đặt câu hỏi như "Ai là ứng cử viên đang tranh cử trong cuộc bầu cử giữa kỳ năm 2026 của Hoa Kỳ?", hệ thống sẽ được kích hoạt. Các đánh giá năm 2026 cho thấy Opus 4.7 và Sonnet 4.6 đã kích hoạt tìm kiếm web trong 92% và 95% các câu hỏi tương tự. Theo StartupHub.ai (2026), việc tích hợp tìm kiếm thời gian thực là một bước đi quan trọng để chống lại thông tin lỗi thời trong các cuộc thảo luận về bầu cử. Điều này đặc biệt hữu ích khi thông tin về ứng cử viên và các vấn đề chính sách thay đổi nhanh chóng.

Hơn nữa, đối với các câu hỏi về cách thức, địa điểm và thời gian bỏ phiếu, Claude được thiết kế để hướng người dùng đến các nguồn đáng tin cậy. Thay vì tự trả lời, mô hình sẽ cung cấp liên kết đến các trang web chính thức của ủy ban bầu cử hoặc các tổ chức phi đảng phái đã được xác minh. Cách tiếp cận này giảm thiểu nguy cơ cung cấp thông tin sai lệch hoặc lỗi thời.

Anthropic sử dụng các đội "red team" để liên tục kiểm tra và gia cố hệ thống phòng thủ của Claude. Các bài kiểm tra này mô phỏng những nỗ lực thao túng tinh vi, chẳng hạn như các chiến dịch gây ảnh hưởng từ nước ngoài. Điều này giúp xác định và khắc phục các lỗ hổng tiềm ẩn trước khi chúng bị khai thác trong thực tế.

Các bài tập "red teaming" này kiểm tra khả năng của Claude trong việc chống lại các kỹ thuật thuyết phục và thao túng. Theo Anthropic News (2026), các bài kiểm tra này giúp đảm bảo Claude có thể chống lại các nỗ lực gây ảnh hưởng đến diễn ngôn chính trị. Trong các bài kiểm tra mô phỏng chiến dịch gây ảnh hưởng vào năm 2026, các mô hình đã phản hồi phù hợp bằng cách từ chối các yêu cầu có hại trong 90% và 94% các trường hợp. Đây là một phần của chiến lược phòng thủ theo chiều sâu, kết hợp cả các biện pháp an toàn được tích hợp sẵn và giám sát liên tục.

Khi một mô hình được triển khai, nó sẽ chạy với các lớp giám sát bổ sung. Các hệ thống này giúp phát hiện và ngăn chặn các hành vi lạm dụng không bị phát hiện trong giai đoạn huấn luyện. Cách tiếp cận nhiều lớp này rất quan trọng để đối phó với các mối đe dọa luôn thay đổi trong không gian thông tin.

Người dùng đóng vai trò quan trọng trong việc duy trì một môi trường thông tin lành mạnh. Anthropic khuyến khích người dùng báo cáo bất kỳ nội dung đáng ngờ nào họ gặp phải trên Claude.ai. Ngoài ra, việc chủ động kiểm tra chéo thông tin với các nguồn chính thống và sử dụng AI một cách có trách nhiệm là những hành động thiết thực nhất.

Mặc dù Claude được thiết kế để trở nên hữu ích và chính xác, nó không phải là một nguồn chân lý tuyệt đối. Người dùng nên coi các câu trả lời của AI là một điểm khởi đầu cho việc tìm hiểu. Với tỷ lệ kích hoạt tìm kiếm web lên tới 95% cho các câu hỏi bầu cử (2026), Claude cung cấp một công cụ mạnh mẽ để người dùng tự xác minh thông tin. Theo KuCoin (2026), sự hợp tác giữa nhà phát triển AI và cộng đồng người dùng là chìa khóa để đảm bảo tính toàn vẹn của các cuộc bầu cử trong kỷ nguyên số.

Bằng cách báo cáo các vấn đề, người dùng giúp Anthropic cải thiện các mô hình và hệ thống an toàn của mình. Phản hồi này rất có giá trị trong việc xác định các loại thông tin sai lệch mới hoặc các phương pháp lạm dụng tinh vi. Cuối cùng, việc xây dựng một hệ sinh thái thông tin đáng tin cậy là một nỗ lực chung của cả nhà phát triển và người dùng.