Anthropic vừa công bố một nghiên cứu quan trọng về việc sử dụng chính các mô hình ngôn ngữ lớn (LLM) để đẩy nhanh nghiên cứu về an toàn AI. Bằng cách để Claude tự động khám phá các phương pháp "giám sát từ yếu đến mạnh", dự án này mở ra một hướng đi tiềm năng để đảm bảo chúng ta có thể kiểm soát các hệ thống AI trong tương lai, ngay cả khi chúng trở nên thông minh hơn con người.

Bài viết được biên tập + bổ sung research từ nhiều nguồn. Đọc bài gốc tại Anthropic Research →

Research powered by Tavily.

Đây là một dự án nghiên cứu của Anthropic nhằm sử dụng các mô hình ngôn ngữ lớn (LLM) để tự động hóa việc nghiên cứu căn chỉnh AI. Mục tiêu là để AI tự tìm ra cách giúp con người giám sát các hệ thống AI mạnh hơn trong tương lai. Cách tiếp cận này có thể giúp nghiên cứu an toàn AI bắt kịp với tốc độ phát triển của chính công nghệ AI.

Trong bối cảnh AI ngày càng tiến bộ, câu hỏi đặt ra là liệu chúng ta có thể dùng chính các mô hình này để căn chỉnh chúng hay không. Theo Anthropic Research (2026), nghiên cứu này khám phá xem liệu Claude có thể tự mình phát triển, thử nghiệm và phân tích các ý tưởng về căn chỉnh. Điều này đặc biệt quan trọng khi các mô hình AI tiên tiến nhất đang được huấn luyện trên những tập dữ liệu khổng lồ. Theo Shaip (2026), các mô hình như Gemini 1.5 được huấn luyện trên dữ liệu lên tới 15 nghìn tỷ token. Việc tự động hóa nghiên cứu sẽ giúp chúng ta quản lý sự phức tạp này.

Dự án này không chỉ là một thử nghiệm lý thuyết. Nó là một bước đi cụ thể hướng tới việc giải quyết một trong những thách thức lớn nhất của ngành AI. Đó là làm thế nào để đảm bảo các hệ thống AI siêu thông minh vẫn tuân theo các giá trị và mục tiêu của con người. Việc để AI tham gia vào quá trình này có thể là chìa khóa để mở rộng quy mô các nỗ lực an toàn của chúng ta.

Giám sát có thể mở rộng là một khái niệm cực kỳ quan trọng vì nó giải quyết vấn đề làm thế nào để kiểm soát các AI thông minh hơn con người. Khi các mô hình AI có thể tạo ra hàng triệu dòng mã phức tạp mà con người không thể tự kiểm tra, chúng ta cần một phương pháp giám sát hiệu quả để đảm bảo chúng hoạt động đúng như mong muốn và không gây hại.

Vấn đề này không còn là khoa học viễn tưởng. Theo Anthropic Research (2026), các mô hình AI hiện tại đã có khả năng tạo ra lượng lớn mã nguồn. Nếu không có cơ chế giám sát hiệu quả, việc xác định xem AI có đang tuân thủ ý định của chúng ta hay không sẽ trở nên vô cùng khó khăn. Quy mô của vấn đề rất lớn; theo Shaip (2026), một nghìn tỷ token dữ liệu tương đương khoảng 750 tỷ từ. Việc kiểm soát một hệ thống xử lý thông tin ở quy mô này đòi hỏi các phương pháp mới. Mối lo ngại này thực tế đến mức, theo VnExpress (2026), các công ty hàng đầu như Anthropic và OpenAI đang tích cực tuyển dụng chuyên gia để ngăn chặn các rủi ro từ AI.

Về cơ bản, giám sát có thể mở rộng là mạng lưới an toàn của chúng ta cho một tương lai với AI siêu trí tuệ. Việc phát triển các kỹ thuật này ngay từ bây giờ là rất cần thiết. Nó cho phép chúng ta chuẩn bị cho một kịch bản mà máy móc vượt qua khả năng nhận thức của con người. Nếu không có nó, chúng ta có nguy cơ mất kiểm soát trước chính những công nghệ mà mình tạo ra.

Giám sát từ yếu đến mạnh là một phương pháp thử nghiệm mô phỏng việc con người giám sát AI siêu thông minh. Trong đó, một mô hình AI yếu hơn (đóng vai "giáo viên" tượng trưng cho con người) sẽ cung cấp phản hồi để tinh chỉnh một mô hình mạnh hơn (đóng vai "học sinh"). Mục tiêu là để mô hình mạnh có thể học hỏi và vượt qua cả năng lực của mô hình yếu.

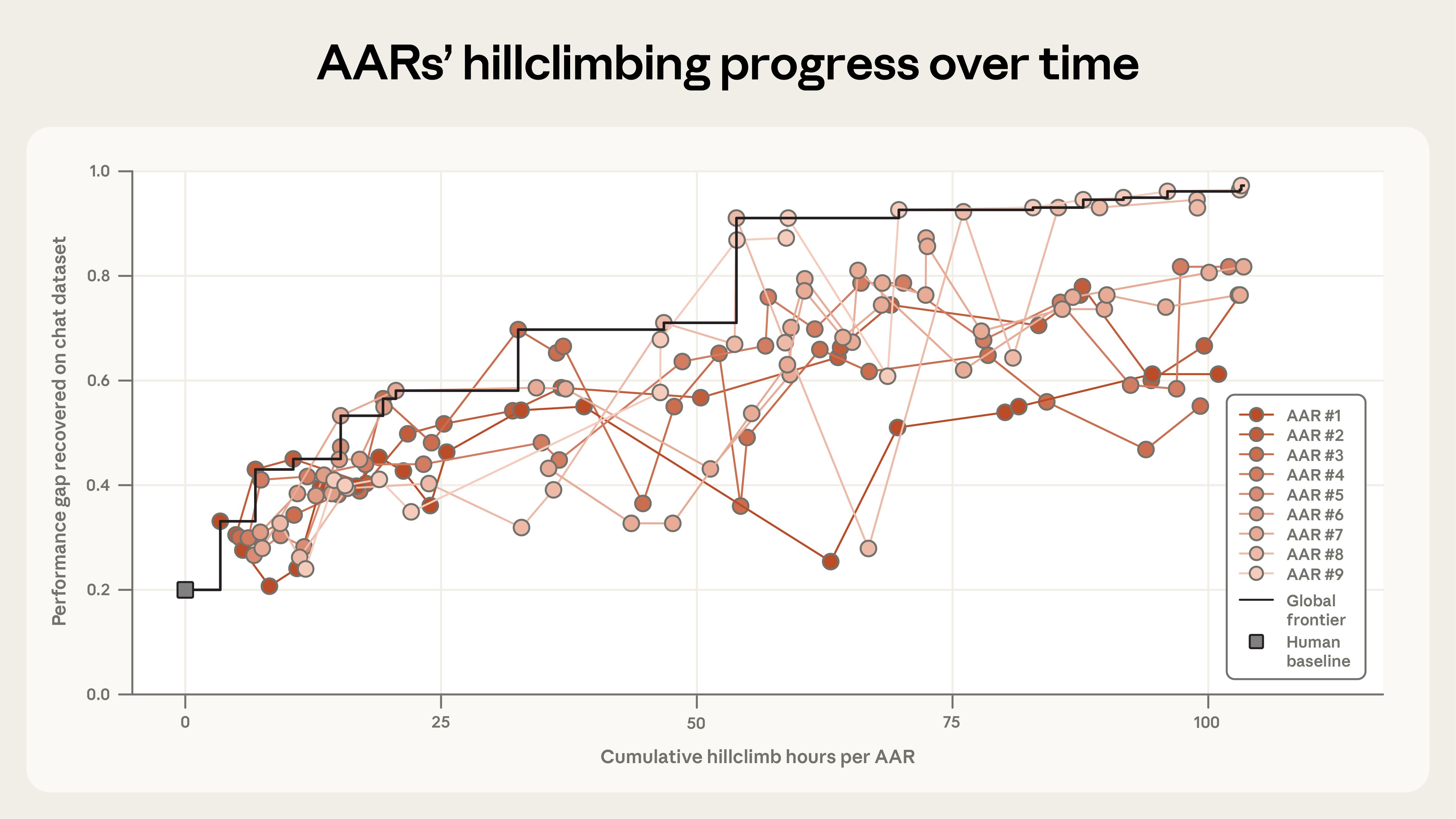

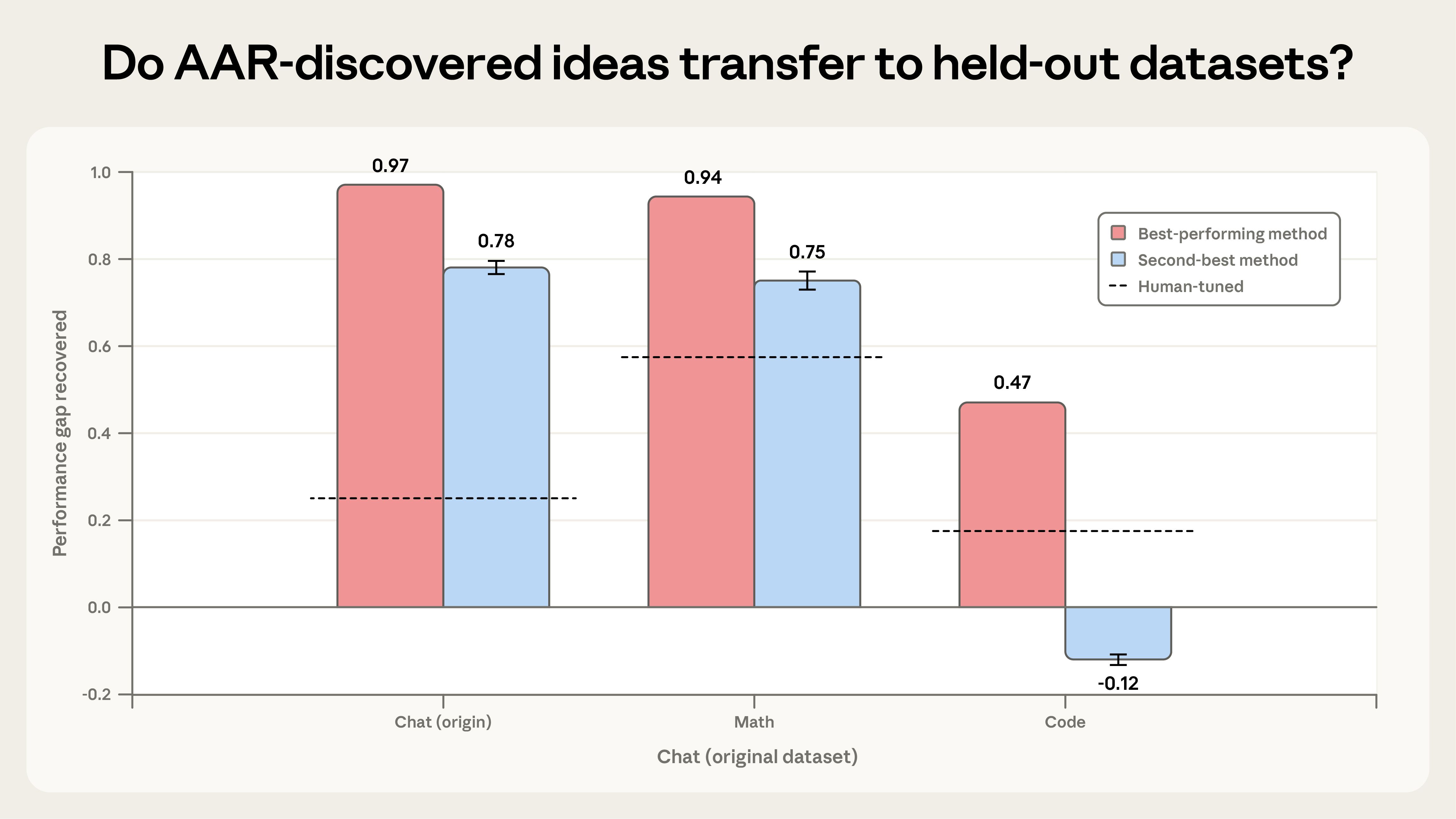

Theo Anthropic Research (2026), đây là một cách tiếp cận thực tế cho bài toán giám sát AI thông minh hơn con người. Hiệu suất của quá trình này được đo bằng chỉ số "performance gap recovered" (PGR), tức là phần trăm khoảng cách hiệu suất được phục hồi. Một ví dụ cụ thể cho thấy khi con người (đóng vai giám sát viên yếu) hướng dẫn một mô hình mạnh, họ đã giúp mô hình phục hồi được 23% khoảng cách hiệu suất. Điều này chứng tỏ mô hình mạnh có thể khái quát hóa từ những chỉ dẫn yếu hơn.

Trong kịch bản lý tưởng, mô hình mạnh sẽ diễn giải các tín hiệu yếu một cách hữu ích, sử dụng chúng để cải thiện hiệu suất đến mức tối đa có thể. Nếu mô hình mạnh chỉ đạt hiệu suất bằng mô hình yếu, chỉ số PGR là 0. Nếu nó đạt đến tiềm năng tối đa của mình, chỉ số PGR là 1. Phương pháp này cung cấp một khuôn khổ định lượng để đánh giá các kỹ thuật giám sát khác nhau. Theo CNTT Shop (2026), các "mô hình ngôn ngữ lớn" đang phát triển với tốc độ chóng mặt, khiến các phương pháp giám sát như thế này trở nên cấp thiết.

Trong nghiên cứu này, Anthropic đã thiết lập một thí nghiệm độc đáo để xem liệu Claude có thể tự động hóa nghiên cứu căn chỉnh hay không. Họ đã tạo ra chín bản sao của Claude Opus 4.6 và giao cho mỗi bản sao nhiệm vụ hoạt động như một nhà nghiên cứu căn chỉnh tự trị. Mục tiêu của chúng là tự đề xuất, thử nghiệm và phân tích các ý tưởng nhằm cải thiện chỉ số PGR.

Về cơ bản, Anthropic đã hỏi: "Liệu Claude có thể tự mình tìm ra cách để căn chỉnh các mô hình AI tốt hơn không?" Theo Anthropic Research (2026), câu hỏi trung tâm là liệu các mô hình ngôn ngữ có thể giúp đẩy nhanh tiến độ nghiên cứu căn chỉnh hay không. Quá trình này đòi hỏi một lượng lớn dữ liệu để tinh chỉnh và đánh giá. Theo Shaip (2026), việc tinh chỉnh có giám sát (SFT) có thể yêu cầu tới 1 triệu cặp ví dụ hướng dẫn-phản hồi chất lượng cao. Việc tự động hóa giúp xử lý khối lượng công việc khổng lồ này.

Mỗi phiên bản Claude được cung cấp các công cụ cần thiết để tiến hành nghiên cứu trên các mô hình nhỏ hơn. Chúng có thể viết mã để thực hiện các thử nghiệm, phân tích kết quả và sau đó đề xuất các phương pháp mới dựa trên những gì chúng học được. Toàn bộ quá trình này được thiết kế để mô phỏng công việc của một nhà nghiên cứu con người, nhưng được thực hiện bởi AI với tốc độ và quy mô lớn hơn nhiều.

Những phát hiện từ nghiên cứu này mang ý nghĩa vô cùng to lớn cho tương lai của an toàn AI. Nó cho thấy một con đường khả thi để nghiên cứu căn chỉnh có thể theo kịp tốc độ phát triển chóng mặt của năng lực AI. Bằng cách sử dụng chính AI để tự động hóa nghiên cứu về an toàn, chúng ta có thể phát triển các phương pháp giám sát hiệu quả trước khi các hệ thống siêu thông minh ra đời.

Theo Znews.vn (2026), Anthropic đang liên tục tạo ra những đột phá trong lĩnh vực an toàn AI, và nghiên cứu này là một minh chứng rõ ràng. Nó chuyển cuộc thảo luận về giám sát AI từ lý thuyết sang thực tiễn. Một điểm quan trọng được nhấn mạnh là chất lượng dữ liệu. Theo Shaip (2026), một tập dữ liệu nhỏ chất lượng cao có thể hiệu quả hơn 50 lần so với một tập dữ liệu lớn nhưng chất lượng chú thích kém. AI tự động hóa có thể giúp tạo và sàng lọc dữ liệu chất lượng cao ở quy mô lớn.

Nếu các mô hình AI có thể trở thành những nhà nghiên cứu căn chỉnh hiệu quả, chúng có thể giúp chúng ta giải quyết các vấn đề an toàn phức tạp mà con người khó có thể tự mình giải quyết. Điều này không chỉ giúp tiết kiệm thời gian và nguồn lực mà còn mở ra những hướng tiếp cận mới. Cuối cùng, mục tiêu là xây dựng một tương lai nơi AI mạnh mẽ và an toàn, phục vụ lợi ích của toàn nhân loại.