Anthropic chính thức công khai chương trình tiền thưởng tìm lỗi bảo mật (bug bounty) trên nền tảng HackerOne, mời gọi cộng đồng hacker toàn cầu tham gia. Sau giai đoạn thử nghiệm riêng tư thành công, động thái này mở ra cơ hội cho bất kỳ ai cũng có thể báo cáo lỗ hổng trong các mô hình AI như Claude và nhận phần thưởng giá trị, đánh dấu một bước tiến quan trọng trong việc xây dựng AI an toàn và minh bạch.

Bài viết được biên tập + bổ sung research từ nhiều nguồn. Đọc bài gốc tại External →

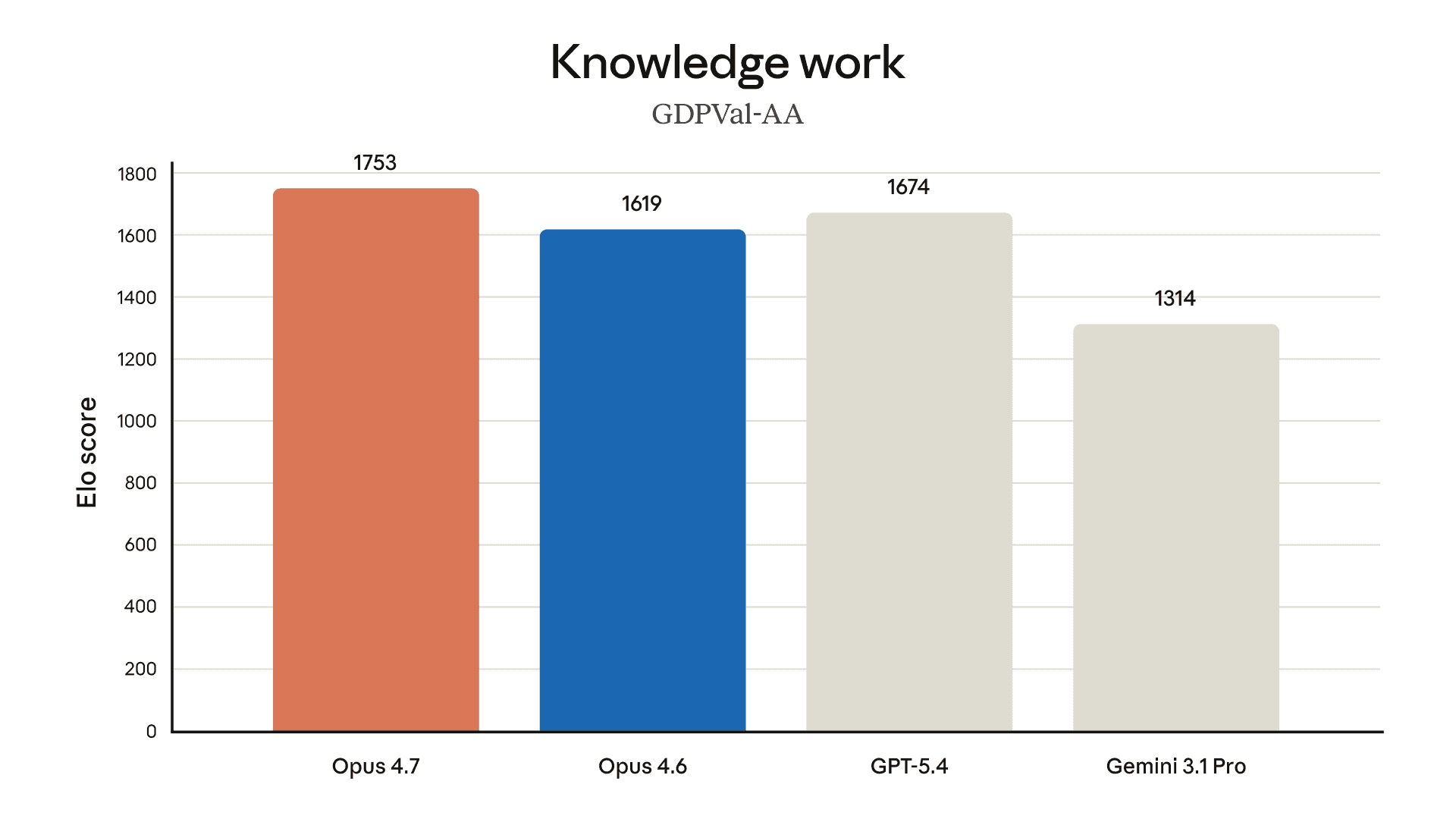

Anthropic vừa ra mắt Claude Opus 4.7, một bản nâng cấp đáng kể tập trung vào kỹ thuật phần mềm phức tạp và thị giác máy tính. Phiên bản này không chỉ thông minh hơn trong việc xử lý các tác vụ lập trình dài hơi mà còn đi kèm các biện pháp bảo vệ an ninh mạng tiên tiến, đánh dấu một bước tiến quan trọng trong việc phát triển AI có trách nhiệm.

04/05/2026

Anthropic và Amazon vừa công bố mở rộng hợp tác chiến lược, một bước đi quan trọng trong cuộc đua AI. Với cam kết hạ tầng trị giá 100 tỷ USD và khoản đầu tư lên tới 25 tỷ USD từ Amazon, Anthropic sẽ có thêm 5 gigawatt năng lực tính toán. Thỏa thuận này không chỉ củng cố vị thế của Claude trên nền tảng AWS mà còn hứa hẹn nâng cao hiệu suất và khả năng tiếp cận cho người dùng toàn cầu.

04/05/2026

Research powered by Tavily.

Anthropic và NEC công bố hợp tác chiến lược, một bước tiến quan trọng cho thị trường AI Nhật Bản. Thỏa thuận này không chỉ đưa Claude đến 30.000 nhân viên NEC mà còn đặt mục tiêu xây dựng lực lượng kỹ sư AI lớn nhất quốc gia. Cả hai sẽ cùng phát triển các giải pháp chuyên ngành an toàn, đáng tin cậy cho tài chính, sản xuất và chính phủ, khẳng định cam kết về một tương lai AI có trách nhiệm.

04/05/2026

Đây là một sáng kiến của Anthropic, công ty nghiên cứu an toàn AI, hợp tác với nền tảng HackerOne. Chương trình cho phép các nhà nghiên cứu bảo mật và hacker trên toàn thế giới tìm và báo cáo các lỗ hổng trong sản phẩm của Anthropic, bao gồm cả mô hình Claude. Đổi lại, họ sẽ nhận được phần thưởng tài chính, tùy thuộc vào mức độ nghiêm trọng của lỗi được phát hiện.

Mục tiêu của Anthropic là xây dựng các hệ thống AI đáng tin cậy, có thể diễn giải và điều khiển được. Việc mở rộng chương trình bug bounty là một phần quan trọng trong chiến lược này. Nó tận dụng trí tuệ tập thể để xác định các điểm yếu tiềm ẩn. Theo HackerOne (2026), việc phát hiện lỗ hổng AI đang tăng nhanh hơn 281% so với khả năng khắc phục. Điều này cho thấy sự cấp thiết của các chương trình chủ động như của Anthropic.

Trước đây, chương trình này chỉ hoạt động ở chế độ riêng tư. Nó chỉ dành cho một nhóm nhỏ các nhà nghiên cứu được mời. Giờ đây, việc công khai hóa mở ra cánh cửa cho bất kỳ ai có kỹ năng và sự quan tâm.

Anthropic công khai chương trình nhằm mở rộng quy mô và đa dạng hóa nguồn lực tìm kiếm lỗ hổng. Việc chuyển từ một nhóm riêng tư sang cộng đồng toàn cầu giúp họ phát hiện được nhiều loại lỗi hơn. Điều này giúp củng cố hệ thống phòng thủ trước các mối đe dọa thực tế. Cách tiếp cận này thể hiện cam kết về tính minh bạch và an toàn trong phát triển AI.

Trong thông báo chính thức, Anthropic đã nêu rõ: "Chương trình tiền thưởng tìm lỗi bảo mật của chúng tôi hiện đã công khai trên HackerOne. Chúng tôi đã chạy chương trình một cách riêng tư trong cộng đồng nghiên cứu bảo mật, và những phát hiện của họ đã củng cố sản phẩm của chúng tôi. Giờ đây, bất kỳ ai cũng có thể báo cáo lỗ hổng và nhận thưởng." Theo Anthropic (2026), chương trình này cũng là cơ hội để các nhà nghiên cứu mới tham gia sau thành công của giai đoạn kín vào năm trước. Động thái này không chỉ giúp cải thiện sản phẩm mà còn xây dựng lòng tin với người dùng.

Chương trình tập trung vào các lỗ hổng bảo mật trong các mô hình và hệ thống của Anthropic. Phạm vi bao gồm các vấn đề như vượt qua bộ lọc an toàn (jailbreaking), trích xuất dữ liệu nhạy cảm, và các hành vi không mong muốn của mô hình. Phần thưởng được xác định dựa trên mức độ nghiêm trọng và tác động của lỗ hổng, với các khoản tiền đáng kể cho các phát hiện quan trọng.

Trước khi công khai, Anthropic đã tổ chức các sự kiện chuyên biệt. Một ví dụ là "Jailbreak Challenge" trên HackerOne. Trong thử thách này, các nhà nghiên cứu phải cố gắng phá vỡ hàng rào bảo vệ của Claude. Theo HackerOne (2026), những người tham gia thành công đã nhận được phần thưởng lớn. Cụ thể, 10.000 USD cho người đầu tiên vượt qua các cấp độ bằng các jailbreak khác nhau. Và 20.000 USD cho người đầu tiên sử dụng một "universal jailbreak" duy nhất để vượt qua tất cả. Những sự kiện này cho thấy mức độ đầu tư nghiêm túc của Anthropic vào việc bảo mật.

Chương trình của Anthropic khác biệt ở tính liên tục và cởi mở. Thay vì các cuộc thi hoặc kiểm tra nội bộ một lần, đây là một kênh thường trực. Nó cho phép cộng đồng bảo mật toàn cầu liên tục kiểm tra và báo cáo lỗi trên các hệ thống đang hoạt động. Cách tiếp cận này mang tính đối kháng và thực tế hơn, mô phỏng các cuộc tấn công trong thế giới thực.

Nó cũng vượt ra ngoài các thách thức cụ thể như "Jailbreak Challenge" trước đây. Trong khi các thách thức đó tập trung vào một mục tiêu hẹp, chương trình công khai có phạm vi rộng hơn. Theo Anthropic (2026), một mục tiêu quan trọng là để các nhà nghiên cứu tìm ra các "universal jailbreaks" trong các bộ phân loại an toàn chưa được triển khai công khai. Điều này cho thấy một chiến lược phòng thủ theo chiều sâu, tìm kiếm lỗ hổng ngay cả trong các công nghệ tương lai.

Các chuyên gia bảo mật và hacker mũ trắng tại Việt Nam có thể tham gia dễ dàng. Họ chỉ cần truy cập nền tảng HackerOne và tìm chương trình của Anthropic. Sau khi tạo tài khoản, họ có thể xem xét chi tiết về phạm vi, các loại lỗ hổng được chấp nhận và quy trình báo cáo. Đây là cơ hội để cộng đồng Việt Nam thể hiện năng lực trên trường quốc tế.

Việc tham gia không chỉ mang lại phần thưởng tài chính. Nó còn giúp các chuyên gia Việt Nam đóng góp vào sự an toàn của một trong những công nghệ AI tiên tiến nhất thế giới. Xu hướng này ngày càng phổ biến. Theo VSEC (2026), các gã khổng lồ công nghệ khác như Apple cũng treo thưởng hàng triệu USD để thu hút tài năng bảo mật. Điều này khẳng định vai trò quan trọng của cộng đồng hacker trong việc bảo vệ hệ sinh thái kỹ thuật số.

Chương trình này có thể thiết lập một tiêu chuẩn mới về tính minh bạch và trách nhiệm trong ngành AI. Bằng cách chủ động mời gọi sự giám sát từ bên ngoài, Anthropic đang thúc đẩy một văn hóa an toàn cởi mở. Điều này khuyến khích các công ty AI khác áp dụng các biện pháp tương tự, thay vì chỉ dựa vào kiểm tra nội bộ.

Sự hợp tác này giúp thu hẹp khoảng cách giữa việc phát hiện và khắc phục lỗ hổng. Theo một báo cáo của HackerOne (2026), việc phát hiện lỗ hổng AI đã tăng 282%, cho thấy nhu cầu cấp thiết phải có các cơ chế phản ứng nhanh. Bằng cách tận dụng sức mạnh của cộng đồng, Anthropic không chỉ bảo vệ người dùng của mình. Họ còn góp phần xây dựng một tương lai AI mạnh mẽ và an toàn hơn cho tất cả mọi người.